I. INTRODUCCIÓN

La luminancia es una de las magnitudes más importantes en el diseño e investigación en iluminación. La luminancia es la densidad de radiación visible en una determinada dirección  .1

.1

Hay numerosas situaciones en las que se requiere la evaluación de la luminancia en escenas complejas. Por ejemplo, para evaluar el deslumbramiento de la iluminación natural o artificial en un lugar de trabajo o para verificar los requerimientos del alumbrado público. Ante estas situaciones se utilizan dos métodos conocidos: 1) la medición de la luminancia punto por punto mediante un luminancímetro convencional; 2) el uso de un dispositivo que analiza las imágenes en dos dimensiones. El inconveniente de la primera solución es obvio: puede llevar mucho tiempo si queremos tener una buena caracterización de la escena, y puede ser prácticamente imposible si se tiene una variación importante de la fuente de luz, como podría suceder con la iluminación natural. Por otra parte, los fotómetros de imagen se han desarrollado, hace varios años, colocando filtros V( ) muy precisos a las cámaras, lo que los hace extremadamente caros. Recientemente, nuevos enfoques han propuesto la implementación de un filtro V(

) muy precisos a las cámaras, lo que los hace extremadamente caros. Recientemente, nuevos enfoques han propuesto la implementación de un filtro V( ) en una cámara DSLR (Digital Single Lens Reflex), a partir de la combinación lineal de las salidas de los canales RGB, lo que requiere una caracterización minuciosa del sensor de la cámara.2-5

) en una cámara DSLR (Digital Single Lens Reflex), a partir de la combinación lineal de las salidas de los canales RGB, lo que requiere una caracterización minuciosa del sensor de la cámara.2-5

Los presupuestos para el trabajo científico en Argentina se han reducido drásticamente en los últimos años. Debido a esta situación, decidimos implementar en el ILAV nuestro propio fotómetro de imagen y un software de código abierto para el procesamiento de las fotografías. Para cumplir con este objetivo, en este artículo describimos las actividades más importantes realizadas en la caracterización de la cámara. En primer lugar, fue necesario obtener la respuesta o sensibilidad de la cámara a diferentes longitudes de onda, es decir, de manera análoga al funcionamiento del ojo humano, la función V( ) de la cámara. La segunda actividad consistió en la caracterización de la lente de la cámara: medimos su transmitancia espectral y el efecto conocido como viñeteo o pérdida de luz que llega al sensor de la cámara en la periferia.

) de la cámara. La segunda actividad consistió en la caracterización de la lente de la cámara: medimos su transmitancia espectral y el efecto conocido como viñeteo o pérdida de luz que llega al sensor de la cámara en la periferia.

II. DESCRIPCIÓN DE LA CÁMARA

En términos de la señal procesada, las cámaras DSLR son dispositivos que funcionan de acuerdo con el diagrama de bloques mostrado en la Fig. 1 para la obtención de imágenes digitales.

Primeramente, una fuente de luz con una determinada irradiancia espectral,  , ilumina el objeto a fotografiar. El objeto cuenta con una característica reflectancia espectral,

, ilumina el objeto a fotografiar. El objeto cuenta con una característica reflectancia espectral,  , que afecta la radiación que recibe y produce una propia radiancia espectral. Esta señal entra en la cámara DSLR, lo que implica atravesar una serie de elementos de la cámara, comenzando por la lente que tiene una determinada transmitancia espectral,

, que afecta la radiación que recibe y produce una propia radiancia espectral. Esta señal entra en la cámara DSLR, lo que implica atravesar una serie de elementos de la cámara, comenzando por la lente que tiene una determinada transmitancia espectral,  . Posteriormente pasa por un filtro infrarrojo,

. Posteriormente pasa por un filtro infrarrojo,  y por un arreglo de filtros de colores (

y por un arreglo de filtros de colores ( ;

;  ;

;  ). Finalmente, la señal llega al sensor de la cámara formado por una matriz de píxeles, el cual tiene una determinada sensibilidad,

). Finalmente, la señal llega al sensor de la cámara formado por una matriz de píxeles, el cual tiene una determinada sensibilidad,  . La señal analógica que atraviesa todas estas etapas es convertida en digital y recibe un procesamiento que dependerá de los parámetros pre-establecidos en la cámara para finalmente grabar en una memoria la imagen deseada.

. La señal analógica que atraviesa todas estas etapas es convertida en digital y recibe un procesamiento que dependerá de los parámetros pre-establecidos en la cámara para finalmente grabar en una memoria la imagen deseada.

FIG. 1: Proceso que recorre una señal electromagnética para obtener una imagen en una cámara DSLR.

Para poder utilizar a la cámara DSLR como fotómetro, es necesario asociar a cada señal recibida por los píxeles, un valor de luminancia absoluta de la escena a evaluar. Esto implica caracterizar todas las etapas encerradas en el rectángulo con línea intermitente mostrado en la Fig. 1. Posteriormente, para evitar los pre-ajustes de la cámara que alteran la relación entre la señal de entrada y la que producen los píxeles, será necesario realizar un procesamiento propio de los datos mediante un software desarrollado específicamente para producir una imagen que reproduzca de manera fiel los niveles de luminancia real de la escena.

III. RESPUESTA ESPECTRAL DEL SENSOR RGB

Decidimos caracterizar por separado la cámara y la lente, debido a que, si se desea utilizar a la cámara con otra lente, sólo sería necesario medir las características de la lente nueva y viceversa, lo cual implica un trabajo considerablemente menor.

Para caracterizar la cámara se requiere obtener las curvas características del arreglo de filtros RGB y, a partir de estas, realizar una aproximación a la curva V( ) del ojo humano.

) del ojo humano.

Arreglo experimental

En este trabajo utilizamos una cámara Canon EOS 30D con un sensor CMOS de 3504 x 2336 píxeles. El primer paso en la caracterización de la cámara consistió en obtener la respuesta del sensor a una fuente de luz conocida en el espectro visible. Con tal propósito, medimos el espectro de una lámpara de referencia mediante el arreglo experimental mostrado en la Fig. 2.

La fuente de luz de referencia es una lámpara incandescente halógena marca OSRAM modelo HALOPAR30 de 75 W a 220 V que colocamos a 4 cm de la abertura de una esfera integradora. Para mantener constante el flujo luminoso de la fuente de luz, controlamos la corriente de suministro en todo momento mediante su medición continua. La esfera integradora proporcionó entonces la luz de entrada al monocromador. El monocromador espectrorradiómetro es un OPTRONIC OL 750. A la salida del monocromador colocamos un detector que, conectado a una computadora, midió la distribución de potencia espectral (SPD) de la lámpara entre los 378 nm y 710 nm con una resolución de 4 nm (Fig. 2).

Posteriormente, desacoplamos el detector de la salida del monocromador y en su lugar colocamos a la cámara DSLR sin la lente (Fig. 3). El monocromador es un equipo que, mediante el uso de filtros y espejos, separa las longitudes de onda que componen una determinada señal luminosa. Con base en esto, programamos el monocromador para que separara las longitudes de onda componentes de la lámpara de referencia, de tal manera que proyectara sobre el sensor de la cámara una “mancha" de luz que correspondía a cada longitud de onda. Tomamos entonces fotografías cada 4 nm entre los 378 nm y los 710 nm para 23 tiempos de exposición distintos. Esto implicó tomar alrededor de 2000 fotografías. Para esta tarea utilizamos el software DSLR remote Pro que permite tomar fotografías a distancia desde una computadora para evitar el riesgo de alterar la posición de la cámara, además es posible manipular los tiempos de exposición de la cámara.

Obtención de las curvas RGB

Para obtener las curvas RGB, se relaciona la respuesta de cada canal del sensor con la SPD de la lámpara de referencia, para cada longitud de onda, y se normaliza. Es decir que cada punto de la curva es la razón entre la señal del sensor y la intensidad de la lámpara, normalizado.

Tomamos las imágenes en formato .CR2, el cual es el formato de fotografías RAW de Canon. Las imágenes RAW son aquellas que no han recibido ningún procesamiento por parte de la cámara, es decir, que contienen la totalidad de los datos de la imagen tal y como fueron captados por el sensor de la cámara.

La intensidad de los píxeles se obtiene de las fotografías en formato RAW mediante una rutina escrita en Matlab que a su vez incorpora el programa dcraw6 que decodifica imágenes RAW.

Una vez hecho esto, para cada longitud de onda dividimos el valor de intensidad del espectro de la lámpara entre el valor de la suma de las intensidades de todos los píxeles del sensor para la misma longitud de onda. Este proceso se repite para todas las longitudes de onda y para cada canal, de esta manera, calculamos las curvas características de los canales R, G y B de la cámara para cada tiempo de exposición (Fig. 4, líneas continuas). Estas curvas son representativas del arreglo de filtros RGB y, además, implícitamente está incluido el filtro IR de la cámara (Fig. 1). Sin embargo, falta considerar la transmitancia espectral de la lente.

FIG. 4: En líneas continuas mostramos las respuestas espectrales normalizadas del conjunto de filtros R, G y B de la cámara DSLR para un tiempo de exposición de 1/2 s. La línea negra discontinua representa la transmitancia espectral de la lente de la cámara (ver Sección V). Por último, las líneas discontinuas azul, verde y roja son las curvas espectrales características de los canales R, G y B de la cámara ya corregidas con la transmitancia de la lente.

IV. APROXIMACIÓN A LA CURVA DE SENSIBILIDAD DEL OJO HUMANO

Con el arreglo de filtros RGB de la cámara DSLR (Fig. 4), se puede realizar una aproximación a la función de eficiencia luminosa del ojo humano en el fotópico, V( ). Esta aproximación a V(

). Esta aproximación a V( ) la llevamos a cabo a partir de la combinación lineal de las curvas de los canales R, G, y B del conjunto cámara-lente, es decir,

) la llevamos a cabo a partir de la combinación lineal de las curvas de los canales R, G, y B del conjunto cámara-lente, es decir,

Determinamos los coeficientes  ,

,  y

y  por medio de la minimización del error cuadrático medio de la diferencia entre V(

por medio de la minimización del error cuadrático medio de la diferencia entre V( ) y

) y  . Este proceso se realizó mediante iteraciones con una rutina programada en Matlab. Como ejemplo, para un tiempo de exposición de

. Este proceso se realizó mediante iteraciones con una rutina programada en Matlab. Como ejemplo, para un tiempo de exposición de  s, los valores de los coeficientes son:

s, los valores de los coeficientes son:  ;

;  y

y  . En la gráfica de la Fig. 5 presentamos tanto la curva de sensibilidad del ojo humano en el fotópico, V(

. En la gráfica de la Fig. 5 presentamos tanto la curva de sensibilidad del ojo humano en el fotópico, V( ), como la curva aproximada para la cámara,

), como la curva aproximada para la cámara,  .

.

V. CARACTERIZACIÓN DE LA LENTE

En cuanto a la caracterización de la lente, medimos dos efectos: la curva de transmitancia espectral y el viñeteo.

Medición de la transmitancia espectral

La lente que utilizamos es una Canon EF-S 18-55 mm f/3.5-5.6. Para obtener su transmitancia, en primer lugar, medimos nuevamente el espectro de la fuente de luz como se muestra en la Fig. 2. Posteriormente, colocamos a la lente entre la fuente de luz y la entrada de la esfera integradora tal como se aprecia en el arreglo experimental de la Fig. 6 y medimos nuevamente el espectro de la luz después de pasar por la lente. Al comparar (dividir) entonces ambos espectros, obtuvimos la transmitancia espectral de la lente, la cual mostramos en línea negra intermitente en la Fig. 4.

En la Fig. 4 también se puede observar la corrección de las curvas de los canales R, G y B de la cámara cuando se considera la transmitancia espectral de la lente (líneas roja, verde y azul intermitentes, respectivamente).

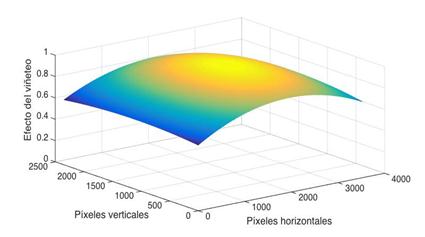

Medición del efecto de viñeteo producido por la lente

En cuanto a la caracterización de la lente, es indispensable considerar un efecto conocido como viñeteo (vignetting). El viñeteo es la disminución gradual de la luminancia capturada por una cámara hacia el borde de una imagen. A medida que la luz entra en la lente, los elementos ópticos, como el diafragma, obstruyen algunos de los rayos no axiales a la lente. Esto impide que la luz entrante llene completamente la apertura y el sensor de la cámara.5 El efecto del viñeteo puede variar en función de la estructura óptica de la lente y del sensor de la cámara, lo que implica diferentes magnitudes de disminución de la luminancia en función de la combinación cámara-lente. Además, como el viñeteo óptico se produce por la obstrucción de los rayos de luz por el diafragma, el ajuste de apertura de la cámara para la captura de imágenes evidentemente afectará el grado de viñeteo. Se sabe que el viñeteo aumenta con aperturas más grandes, es decir, valores de f más pequeños.5

Se conocen al menos dos métodos para medir el efecto del viñeteo para cada combinación específica de apertura/cámara/lente. El primero de ellos consiste en tomar una fotografía a una superficie iluminada cuasi perfectamente uniforme y que incluya todo el sensor de la cámara, de tal manera que, al obtener los valores de intensidad de los píxeles, se pueda medir las diferencias entre la periferia y el centro de la imagen.2,7-9 Este método, aunque parece sencillo, debido a que solamente requiere tomar una fotografía, en realidad tiene la gran dificultad de construir una superficie iluminada que cubra todo el sensor de la cámara y que tenga una uniformidad muy alta.

En este trabajo utilizamos un segundo método, que consiste en fotografiar una superficie pequeña iluminada que se encuentra fija, girando la cámara sobre sus ejes horizontal y vertical hasta cubrir por completo el sensor de la cámara.3,10,11 En una superficie pequeña es mucho más fácil lograr una buena uniformidad, sin embargo, este método implica tomar una gran cantidad de fotografías.

El diseño experimental para tomar estas mediciones consistió en una caja iluminada en su interior por un arreglo de 4 lámparas incandescentes marca OSRAM de 40 W distribuidas uniformemente en la periferia de la parte frontal de la caja (Fig. 7). Estas lámparas están conectadas en serie y son alimentadas con una fuente de corriente directa a 40 V, aproximadamente. Durante todas las mediciones controlamos y mantuvimos constante el valor de la corriente a 3.25 A.

FIG. 7: Colocamos un cuadrado gris dentro de una caja de luz que provee una luminancia con alta uniformidad. Desde la abertura frontal de la caja tomamos las fotografías girando la cámara en sus ejes vertical y horizontal. Al mismo tiempo estuvimos controlando la luminancia del cuadrado gris.

La caja, además de tener una ventana al frente que permite realizar las mediciones, cuenta con una puerta lateral desmontable que posibilita una fácil manipulación de los elementos en su interior. Dentro de la caja colocamos una cartulina o tabla de colores Macbeth ColorChecker a la cual le cubrimos con cartulina negra mate, 23 de las 24 muestras de color que contiene, dejando únicamente al descubierto el cuadrado de 2.5 cm × 2.5 cm correspondiente a la muestra de color 22 (Neutral 5), el cual tiene un color gris (CIE xyY’: 0.310, 0.316, 19.8).

Posteriormente, mediante el uso de un luminancímetro de alta precisión LMT L 1009 y con un ángulo de campo de 20’, medimos la luminancia en 9 puntos del cuadrado gris para calcular su uniformidad de la siguiente manera:

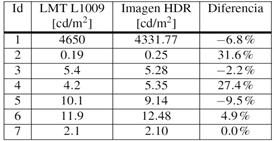

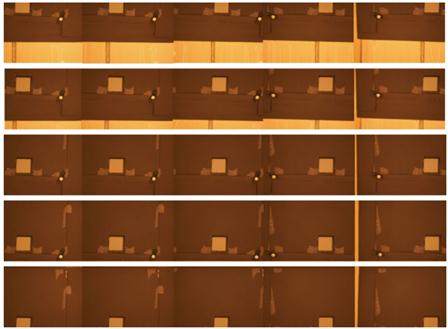

Finalmente, colocamos a la cámara DSLR a una distancia de 73.5 cm entre el cuadrado gris y el sensor de la cámara. Desde esta posición de la cámara, comenzamos a tomar fotografías: la primera colocando en el centro del sensor, la imagen del cuadrado gris y después girando, primeramente, sobre su eje vertical y posteriormente sobre el horizontal, hasta cubrir la totalidad del sensor. En la Fig. 8 se muestra como ejemplo una secuencia de las fotografías tomadas.

FIG. 8: Secuencia de fotos tomadas al girar la cámara en sus ejes horizontal y vertical para cubrir la totalidad del sensor de la cámara con un cuadrado gris de alta uniformidad.

Tomamos las fotografías en formato RAW con aperturas del diafragma f/4.5 y f/5.6, y para las distancias focales 18 mm y 55 mm.

Procesamos las fotografías con una rutina escrita en Matlab mediante la cual, primeramente, obtuvimos los valores de las intensidades de todos píxeles en cada fotografía, después identificamos los correspondientes al cuadrado gris y por último se integraron todos estos píxeles en una sola matriz que representaría una imagen completamente llena de cuadrados grises.

En la Fig. 9 mostramos, como ejemplo, la matriz normalizada obtenida a partir del procedimiento descrito para la distancia focal 55 mm y apertura del diafragma f/5.6. Es evidente el efecto del viñeteo producido por la lente sobre la imagen en el sensor. Esta matriz servirá para corregir los efectos del viñeteo en las mediciones con el luminancímetro de imagen.

VI. CALIBRACIÓN FOTOMÉTRICA ABSOLUTA EN LUMINANCIA

La calibración de la luminancia se realiza escalando linealmente los valores de los píxeles en relación con una luminancia de referencia conocida. En el momento de la captura de la imagen, utilizamos un luminancímetro puntual calibrado para medir la luminancia de referencia.

En la Fig. 10 presentamos el arreglo experimental para la calibración. Este arreglo consistió en una fuente de luz muy intensa (proyector con lámpara incandescente) cuya emisión lumínica es recibida por una pantalla con un difusor acrílico blanco pequeño. Enfrente de la pantalla colocamos la cámara y un luminancímetro LMT L 1009.

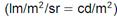

Con este arreglo logramos una luminancia máxima cercana a las 20.000 cd/m2. Para poder cubrir un amplio margen de luminancias en las mediciones, colocamos progresivamente filtros neutros entre la cámara y la pantalla de acrílico para disminuir el nivel de luminancia. Tomamos entonces fotografías RAW a siete niveles distintos de luminancia para los tiempos de exposición: 1/1250 s, 1/125 s, 1/15 s, 1/2 s (Fig. 11). Finalmente procesamos las imágenes para extraer el promedio de las intensidades de los píxeles en el centro de cada fotografía y asociarlas con los valores de luminancia puntual medida en esa misma zona.

VII. IMAGEN HDR Y PRUEBA PILOTO DE MEDICIÓN DE LUMINANCIAS

Finalmente llevamos a cabo la primera prueba para calcular la luminancia en una imagen tomada con la cámara. Para esto elegimos una escena del ILAV que tuviera una importante variación en luminancia. En la Fig. 12 se muestran las cuatro fotografías tomadas con los tiempos de exposición utilizados en la calibración, es decir, 1/1250 s, 1/125 s, 1/15 s, 1/2 s; distancia focal 18 mm y apertura del diafragma f/5.6.

A partir de estas fotografías, creamos, mediante una rutina en Matlab, la imagen HDR que mostramos en la Fig. 13.

FIG. 12: Se muestran las fotografías que tomamos en uno de los pasillos del ILAV a cuatro tiempos de exposición 1/1250 s, 1/125 s, 1/15 s, 1/2 s para llevar a cabo la prueba piloto del luminancímetro de imagen.

En la Fig. 14 mostramos la imagen HDR de la escena pero en falso color con una escala en luminancia. Creamos esta imagen mediante un software que estamos desarrollando y que permitirá crear los mapas de luminancia. En la misma figura, presentamos una tabla con los valores de luminancia que calculamos en siete puntos que fueron marcados con una cruz en la imagen. Estos mismos puntos los medimos con el luminancímetro LMT L 1009 inmediatamente después de tomadas las fotografías.

FIG. 14: Imagen HDR en colores falsos que indican el nivel de luminancia. Sobre la imagen marcamos algunos puntos cuyo valor en luminancia aparece en la tabla de abajo.

En la Tabla 1 se muestran las diferencias encontradas entre mediciones realizadas con el luminancímetro LMT L 1009 en algunos puntos del área de evaluación y valores de luminancia de los mismos puntos obtenidos a partir de la imagen HDR. Como puede observarse, en la mayor parte de los casos, las diferencias son menores al 10%, excepto por dos puntos. Uno de estos puntos se encuentra al centro y al fondo de la imagen sobre la tapa del inodoro y cuenta con una luminancia muy baja (Id 2; 0.19 cd/m 2 ). El otro punto (Id 4; 4.2 cd/m 2 ) se encuentra sobre una de las puertas azul-verde ubicadas a la izquierda de la imagen. En otros estudios se ha reportado que precisamente para luminancias muy bajas y para objetos con colores saturados, es donde se encuentran las mayores discrepancias en mediciones de luminancias mediante imágenes HDR.3,5,8

VIII. ANÁLISIS DE LOS RESULTADOS Y CONCLUSIONES

En este trabajo presentamos la metodología y los resultados de la caracterización de una cámara DSLR para la implementación de un luminancímetro de imagen. Este proyecto surge de la necesidad de realizar múltiples mediciones simultáneas de luminancia en escenas complejas en el dominio espacial y temporal. Ejemplos de estas situaciones se dan frecuentemente en el alumbrado público y en la iluminación natural.

Para lograr este objetivo, desarrollamos tres arreglos experimentales. Con el primero de ellos, obtuvimos las curvas espectrales del conjunto de filtros RGB y la transmitancia espectral de la lente. Con las curvas características de los canales R, G y B del sensor de la cámara, calculamos entonces una curva que se aproxima a la función de eficiencia luminosa V( ). Esta curva, que puede denominarse curva de sensibilidad de la cámara, muestra algunas diferencias evidentes con respecto a V(

). Esta curva, que puede denominarse curva de sensibilidad de la cámara, muestra algunas diferencias evidentes con respecto a V( ) (Fig. 5), especialmente entre 550 nm y 600 nm. Es probable que estas diferencias sean una de las fuentes de error más importantes en las mediciones con este equipo.

) (Fig. 5), especialmente entre 550 nm y 600 nm. Es probable que estas diferencias sean una de las fuentes de error más importantes en las mediciones con este equipo.

El segundo arreglo experimental nos permitió determinar la pérdida de luz en la periferia del sensor de la cámara debido al viñeteo. Sobre la base de las mediciones realizadas, construimos una matriz normalizada que describe los efectos del viñeteo (Fig. 9). El inverso de esta matriz la utilizaremos como filtro digital para corregir este efecto en las mediciones.

Finalmente hemos presentado los primeros resultados de una prueba piloto para utilizar la cámara DSLR como un luminancímetro de imagen. Las luminancias extraídas de la imagen HDR muestran discrepancias del orden del 10% con respecto a las mediciones realizadas con el instrumento de referencia, encontrándose algunos pocos puntos con discrepancias que alcanzan el 30%.

Para luminancias bajas, se nota la necesidad de incluir una toma con un tiempo de exposición más alto, de manera que se pueda utilizar mejor el rango dinámico del sensor CMOS. Esto permitirá formar una imagen HDR en donde las zonas con luminancias bajas tengan una mejor exposición y por tanto una mejor relación señal-ruido en la respuesta del sensor.

Las dificultades encontradas con las mediciones de superficies con colores saturados reflejan una de las limitaciónes del tipo de calibración radiométrica realizada en este trabajo. Una posible estrategia para minimzar este problema es modificando de manera heurística la curva V( ) con base en numerosas pruebas de laboratorio.

) con base en numerosas pruebas de laboratorio.

En el futuro, esperamos caracterizar una variedad de cámaras con el objetivo de ofrecer una aplicación web que permita cargar las fotografías y calcular la imagen de luminancias. Este trabajo se basa en la suposición de que, como la respuesta espectral del sensor RGB está determinado por sus características electrónicas, no variará significativamente entre cámaras de las mismas características.